Couche de convolution

En deep learning, les réseaux de neurones convolutifs (CNN ou ConvNet) sont un type de réseaux de neurones profonds généralement utilisés pour reconnaître des motifs présents dans les images. Ils sont également utilisés pour l’analyse de données spatiales, la vision par ordinateur, le traitement du langage naturel, le traitement du signal et bien plus encore. L’architecture d’un réseau convolutif ressemble au modèle de connectivité des neurones dans le cerveau humain et a été inspirée de l’organisation du cortex visuel. Ce type spécifique de réseau de neurones artificiels tire son nom de l’une des opérations les plus importantes du réseau : la convolution.

Qu’est-ce qu’une convolution ?

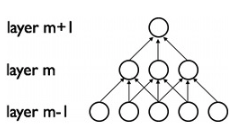

Une convolution est une procédure ordonnée dans laquelle deux sources d’information sont entrelacées. Il s’agit d’une opération qui transforme une fonction en quelque chose d’autre. Les convolutions sont utilisées depuis longtemps, notamment dans le traitement des images pour les rendre floues ou plus nettes. Elles permettent également d’effectuer d’autres opérations (par exemple, pour rehausser les bords et les mettre en relief). Les CNN créent un modèle de connectivité locale entre les neurones des couches adjacentes.  Les CNN utilisent des filtres (également appelés noyaux) pour déterminer quelles caractéristiques sont présentes dans une image. Il peut s’agir des bords, par exemple. Un CNN effectue quatre opérations principales :

Les CNN utilisent des filtres (également appelés noyaux) pour déterminer quelles caractéristiques sont présentes dans une image. Il peut s’agir des bords, par exemple. Un CNN effectue quatre opérations principales :

- La convolution

- La non-linéarité (ReLU)

- Le pooling ou sous-échantillonnage

- La classification (couche Fully Connected)

La première couche d’un réseau de neurones convolutif est toujours une couche de convolution .Les couches convolutives réalisent une opération de convolution sur les données d’entrée et transmettent le résultat à la couche suivante. Une convolution convertit tous les pixels de son champ récepteur en une seule valeur. Si vous réalisez par exemple une convolution sur une image, la taille de l’image va diminuer et toutes les informations du champ seront réunies en un seul pixel. La sortie finale des couches de convolution est un vecteur. En fonction du type de problème à résoudre et du type de caractéristiques à apprendre, on peut utiliser différents types de convolutions.

La couche de convolution 2D

Le type de convolution le plus couramment utilisé est la couche de convolution 2D, généralement abrégée « conv2D ». Un filtre ou un noyau dans une couche conv2D « glisse » sur les données d’entrée 2D, en effectuant une multiplication par éléments. Ainsi, il additionne les résultats en un seul pixel de sortie. Le noyau effectue la même opération pour chaque emplacement sur lequel il glisse, transformant une matrice 2D de caractéristiques en une autre matrice 2D de caractéristiques.

La convolution dilatée ou astrale

Cette opération permet d’augmenter la taille de la fenêtre sans augmenter le nombre de poids en insérant des valeurs nulles dans les noyaux de convolution. Les convolutions dilatées ou astrales peuvent être utilisées dans des applications en temps réel et dans des applications où la puissance de traitement est réduite, puisque les besoins en mémoire vive sont moins importants.

Les convolutions séparables

Il existe deux grands types de convolutions séparables : les convolutions séparables spatiales et les convolutions séparables en profondeur. Les convolutions séparables spatiales traitent principalement les dimensions spatiales d’une image et d’un noyau : la largeur et la hauteur. Les convolutions séparables en profondeur fonctionnent, elles, avec des noyaux qui ne peuvent pas être « factorisés » en deux noyaux plus petits. Elles sont donc plus fréquemment utilisées que les convolutions séparables spatiales.

Les convolutions transposées

Ces types de convolutions sont également connus sous le nom de déconvolutions ou de convolutions fractionnées. Une couche de convolution transposée effectue une convolution normale mais inverse sa transformation spatiale.