Generative KI

Übersicht

- Von Chatbots und Bildgeneratoren bis hin zur Entdeckung von Medikamenten und der Aufdeckung von Betrugsdelikten – generative KI (GenAI) gestaltet die Technologie neu und fördert neue Anwendungen im Einzelhandel, im Finanz- und Gesundheitswesen und in weiteren Bereichen.

- GenAI nutzt Modelle wie Transformer, GANs, VAEs und Diffusionssysteme, um Muster aus riesigen Datasets zu lernen, die ihr dabei helfen, Texte, Bilder, Musik, Code und sogar synthetische Daten zu generieren.

- Während GenAI Produktivitätssteigerungen, neue Revenue Streams und Innovationen verspricht, wirft sie auch Bedenken hinsichtlich Voreingenommenheit, Fehlinformationen, Urheberrecht und der Notwendigkeit einer verantwortungsvollen Governance auf.

Was ist generative KI?

Generative KI, oft abgekürzt als GenAI, ist jede Art von künstlicher Intelligenz, die in der Lage ist, eigenständig neuen Inhalt zu erstellen. Zu den Inhalten der generativen KI gehören Texte, Bilder, Videos, Musik, Übersetzungen, Zusammenfassungen und Code. Sie kann auch bestimmte Aufgaben erfüllen, wie zum Beispiel offene Fragen beantworten, nahezu beliebige Anweisungen ausführen und an Chats teilnehmen.

Die breite Öffentlichkeit wurde durch Dienste wie ChatGPT und DALL-E auf die Bedeutung von GenAI aufmerksam gemacht, was auch die Beliebtheit der Technologie stark erhöhte.

Wie funktioniert generative KI?

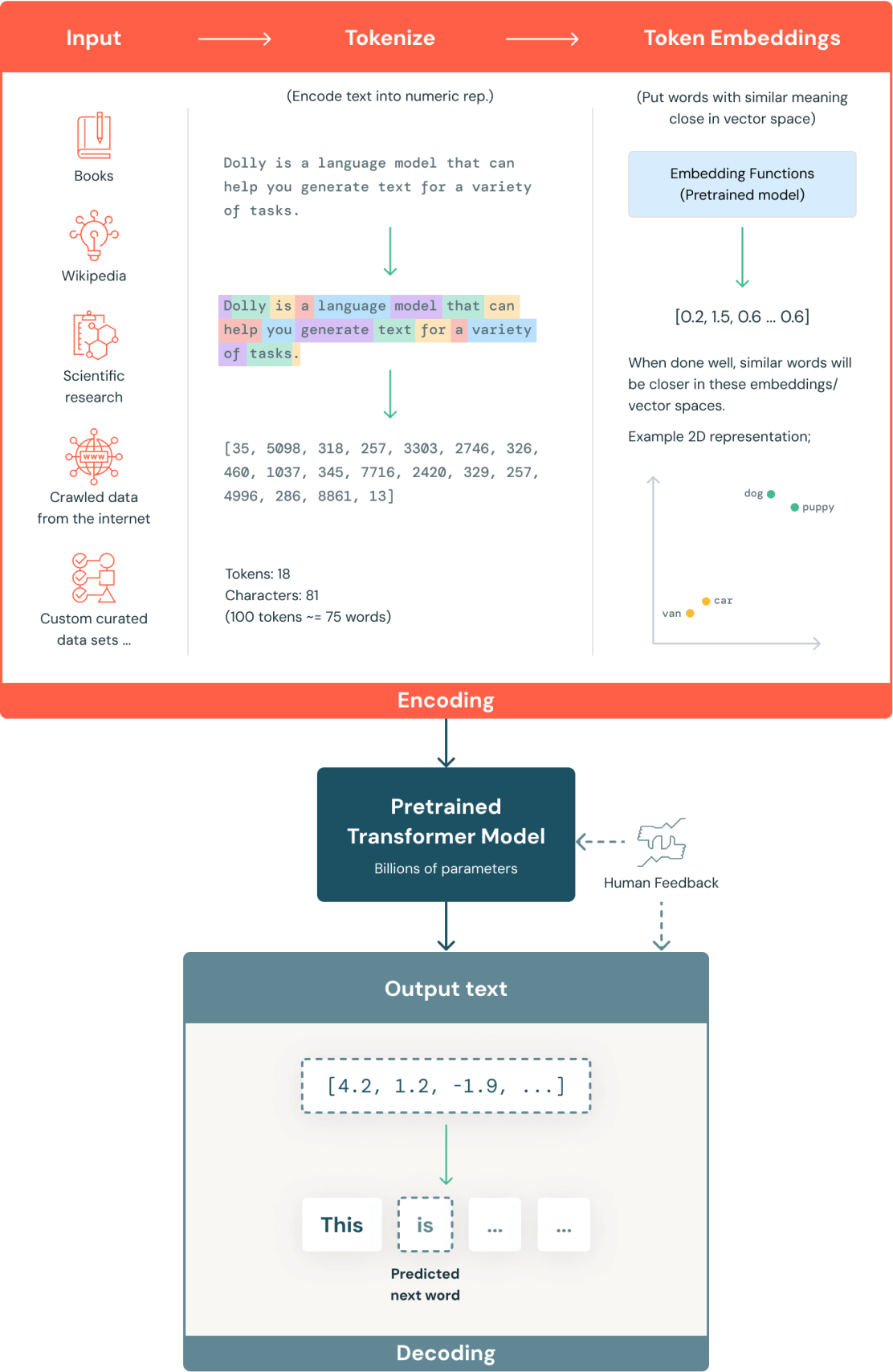

GenAI-Modelle verwenden Deep Learning, um Muster in bestehenden Datensätzen zu identifizieren und zu analysieren. Ähnlich wie das menschliche Gehirn verwenden sie Transformatoren und andere Deep-Learning-Architekturen, um Datensätze zu verarbeiten und daraus zu "lernen". Diese KI-Modelle werden mit riesigen Datenmengen trainiert, um neue und originelle Inhalte zu erstellen.

Sobald es trainiert ist, können Sie dem AI-Modell einen "Prompt" geben, indem Sie etwas wie Text, ein Bild oder eine Sequenz von Musiknoten eingeben. Die Algorithmen erzeugen dann neuen Inhalt als Antwort. Sie können sogar über Medien hinweg arbeiten, zum Beispiel indem sie ein Bild verwenden, um eine Textunterschrift zu erstellen oder ein Bild aus einer Textbeschreibung zu generieren.

Eine gängige Art von generativem AI-Modell sind große Sprachmodelle (LLMs), die auf Text trainiert werden. Diese Modelle lernen, Wörter zu erkennen, die sequenziell verwendet werden. Sie können dann einen Satz bilden, indem sie vorhersagen, welches Wort wahrscheinlich als nächstes in einer Sequenz kommt, was zu einem natürlich klingenden Output führt.

Beispiele für generative KI-Modelle

Es gibt derzeit mehrere Arten von generativen KI-Modellen im Einsatz. Ihre Methoden und Anwendungsfälle unterscheiden sich, aber sie kombinieren alle verschiedene Algorithmen, um Inhalte zu verarbeiten und zu erstellen.

Generative adversarial networks (GANs)

Ein GAN-Modell enthält zwei neuronale Netzwerke, die gleichzeitig trainiert werden. Diese Netzwerke werden als Generator und Diskriminator bezeichnet und sie konkurrieren in einem spielerischen Szenario gegeneinander.

Der Generator erzeugt neue Ausgaben, wie zum Beispiel ein Bild basierend auf einer Aufforderung. Der Diskriminator bewertet dann diesen neuen Inhalt auf Authentizität und gibt dem Generator Feedback, um seine Ausgabe zu verbessern. Der Generator versucht immer, den Diskriminator dazu zu bringen, generierten Inhalt als "echt" zu akzeptieren, während der Diskriminator stets bestrebt ist, besser darin zu werden, den Unterschied zu erkennen.

Ein bekanntes Beispiel für ein GAN-Modell ist Midjourney (ein Text-zu-Bild-GenAI-Tool). GANs sind jedoch nicht auf die Bildgenerierung beschränkt; sie haben auch Text- und Videoinhalte produziert.

Der ständige Wettbewerb zwischen dem GAN-Generator und dem Diskriminator bedeutet, dass sie schnell hochwertige Ergebnisse erzeugen können. Es ist jedoch wichtig, sicherzustellen, dass die beiden Netzwerke ausbalanciert sind, um Probleme wie Overfitting, Mode-Kollaps und abnehmende Gradienten zu vermeiden.

Variational Autoencoder (VAEs)

Autoencoder-Modelle verwenden auch zwei Netzwerke, um Daten zu interpretieren und zu generieren. In diesem Modell werden die Netzwerke als Encoder und Decoder bezeichnet. Das Encoder-Netzwerk wird darauf trainiert, Daten in ein vereinfachtes oder latentes Format zu komprimieren, das Schlüsselfunktionen erfasst. In der Zwischenzeit wird das Decoder-Modell darauf trainiert, Inhalte aus latenten Daten zu rekonstruieren.

VAEs verwenden kontinuierliche latente Räume, um lokale Variationen zwischen Trainingsdatenpunkten zu ermöglichen. Durch das Dekodieren der leicht modifizierten komprimierten Informationen gibt das VAE-Modell ähnliche, aber letztendlich originale Inhalte aus.

Dieses Modell wird oft für die Bildgenerierung und Anomalieerkennung verwendet, kann aber auch Text und Audio erstellen. VAEs sind schnell bei der Generierung von Ausgaben wie Bildern, aber sie können im Vergleich zu einigen anderen Modellen an Detailgenauigkeit fehlen.

Autoregressiv

Autoregressive generative KI-Modelle erstellen neue Proben, indem sie den Kontext von zuvor generierten Elementen berücksichtigen. Sie modellieren die bedingte Wahrscheinlichkeitsverteilung jedes Datenpunkts und erzeugen neue Daten, indem sie das nächste Element in der Sequenz vorhersagen.

Diese Modelle generieren Daten sequenziell, ein Element nach dem anderen, was die Generierung komplexer Sequenzen ermöglicht. Autoregressive AI wird typischerweise in der Textgenerierung (wie ChatGPT), Sprachmodellierung und Musikkomposition verwendet.

Diffusionsmodelle

Diffusionsmodelle werden manchmal auch als denoising diffusion probabilistic models (DDPMs) bezeichnet. Sie werden mit einem zweistufigen Prozess trainiert, der die Vorwärtsdiffusion und die Rückwärtsdiffusion beinhaltet.

Während der Vorwärtsdiffusion wird dem Trainingsdatensatz allmählich zufälliges Gaußsches Rauschen hinzugefügt, was ihn effektiv zerstört. Die AI lernt dann, die Proben durch umgekehrte Diffusion zu rekonstruieren. Sobald sie vollständig trainiert sind, können Diffusionsmodelle neue Daten aus völlig zufälligem Rauschen erzeugen.

Transformers

Transformer verwenden eine spezielle Art von maschinellem Lernen, die ihnen hilft, die langfristigen Beziehungen zwischen sequenziellen Eingabedaten zu verarbeiten. Dies erfordert, dass die Modelle auf größeren Datensätzen trainiert werden.

Dieses Konzept, bekannt als "Aufmerksamkeit", ermöglicht es Transformatoren, herauszufinden, welche Teile der Eingabe andere Teile beeinflussen, d.h., den Kontext zu verstehen. Dies macht sie ideal für Textgenerierungsaufgaben, die eine natürliche Sprachverarbeitung (NLP) erfordern, die ein Verständnis des Kontexts erfordert. Die Mehrheit der bekannten generativen KI-Programme sind Beispiele für auf Transformatoren basierende Modelle.

Transformer haben sich als sehr leistungsfähige Textgeneratoren erwiesen. Dies liegt daran, dass sie nur Text als Trainingsinput benötigen und es Milliarden von Seiten gibt, die verwendet werden können. Neben NLP umfassen andere Anwendungen von Transformer-KI-Modellen das Verfolgen von Verbindungen und das Identifizieren von Beziehungen innerhalb von Code, Proteinen, Chemikalien und DNA.

Verwendung generativer KI-Modellen

Diese Modelltypen eignen sich jeweils für bestimmte Use Cases, zum Beispiel:

- GANs: Hochauflösende Bilder, Videosynthese und Datenerweiterung

- VAEs: Anomalieerkennung und schnelle Bilderzeugung

- Autoregressive Modelle: Textgenerierung, Sprachmodellierung und Tasks mit sequenziellen Daten

- Diffusionsmodelle: Hochwertige Bildsynthese und Anwendungen zur Rauschunterdrückung

- Transformer: NLP, Codegenerierung und multimodale KI

Bei der Bewertung, welches dieser Modelle verwendet werden soll, muss eine Organisation definierte Use Cases und klare Ziele dafür haben, was sie mit jedem Use Case erreichen will. Die Vor- und Nachteile jedes Modells sollten anhand dieser Ziele abgewogen werden, um das Modell auszuwählen, das die besten Ergebnisse für die jeweilige Situation liefert.

Sobald der Use Case festgelegt ist, gibt es mehrere Techniken, die ein Unternehmen anwenden kann, um die Wirksamkeit seiner generativen KI-Modelle zu bewerten und zu überprüfen:

- LEU: Dieses Modell misst die Überlappung zwischen dem generierten Text und dem Referenztext. Ursprünglich für die maschinelle Übersetzung entwickelt, konzentriert sich dieses Modell auf die Präzision der Ausgabe.

- ROUGE: Dieses für die Zusammenfassung konzipierte Modell bewertet den Recall der n-Gramm-Überschneidung und beurteilt, welcher Anteil des Referenzinhalts von der Modellausgabe erfasst wird.

- METEOR, ChrF: Dieses Modell bewertet die Textqualität durch den Vergleich von generiertem Text und Referenztext anhand von Semantik auf Wortebene oder Mustern auf Zeichenebene.

- Perplexität: Dieser Ansatz misst, wie „überrascht“ das Modell vom nächsten Token ist (je niedriger, desto besser). Eine niedrigere Perplexität deutet auf eine bessere Vorhersagefähigkeit hin, auch wenn sie bei Tasks aus der Praxis nicht immer mit der Generierungsqualität korreliert.

- Fréchet Inception Distance (FID) misst anhand von Feature-Verteilungen, wie nahe generierte Bilder an echten Bildern liegen.

- Inception Score (IS) misst die Bildqualität basierend auf der Konfidenz und Vielfalt der vorhergesagten Labels.

- Databricks-Unterstützung: MLflow ermöglicht das Protokollieren und Vergleichen dieser Scores als Teil von Evaluierungs-Pipelines.

Was ist die Rolle von Deep Learning in der generativen KI?

Die Verschiebung hin zu Deep Learning hat AI-Modelle ausgefeilter gemacht und ermöglicht es ihnen, zunehmend komplexe Daten, wie natürliche Sprache, zu modellieren. Die Mehrheit der generativen AI-Modelle wird Deep Learning verwenden.

Der Name Deep Learning kommt von der großen Anzahl von Verarbeitungsschichten, die für diese Modelle verwendet werden. Die erste Schicht von miteinander verbundenen Knoten wird mit Trainingsdaten versorgt. Die Ausgabe aus dieser Schicht wird dann als Eingabe für die nächste Schicht verwendet. Da jede Schicht auf dem Wissen aufbaut, das aus der vorherigen Schicht gewonnen wurde, nehmen Komplexität und Abstraktion zu und die feinen Details von Datensätzen können zum Verständnis von größeren Mustern beitragen.

Während Programmierer bei traditionellem maschinellem Lernen die Merkmalsextraktion durchführen müssen, können Deep-Learning-Programme nützliche Darstellungen von Daten intern mit weniger Aufsicht erstellen.

Darüber hinaus ermöglichen Deep-Learning-Techniken KI-Modellen, komplexe und abstrakte Konzepte wie das Verständnis natürlicher Sprache und die Bilderkennung zu bewältigen.

Es gibt eine Reihe von Möglichkeiten, die Leistung von KI zu verbessern, wie zum Beispiel Datenanreicherung, Transferlernen und Feinabstimmung. Datenanreicherung verwendet generative Modelle, um neue synthetische Datenpunkte für Trainingsdaten zu erstellen. Diese werden dann zu den vorhandenen Daten hinzugefügt, um die Größe und Vielfalt der Datensätze zu erhöhen und folglich die Genauigkeit des Modells zu verbessern.

Transferlernen beinhaltet die Verwendung eines vortrainierten Modells für eine zweite, verwandte Aufgabe. Indem der Output des bestehenden Modells als Input für ein anderes Lernproblem genutzt wird, kann das Modell das Wissen aus der ersten Trainingseinheit anwenden. Ein Beispiel für Transferlernen wäre die Verwendung eines Modells, das darauf trainiert wurde, Autos zu identifizieren, um ein Modell zum Identifizieren anderer Fahrzeuge zu trainieren. Transferlernen ist nützlich, da es die Menge an Daten, die zum Trainieren eines neuen Modells benötigt werden, reduziert.

Schließlich ist das Feintuning eine Technik zur Anpassung eines KI-Modells durch Training mit spezifischeren Daten. Dies ermöglicht es, vortrainierte Modelle für spezifische Domänen oder Aufgaben zu verfeinern. Für das Feintuning werden hochwertige Datensätze benötigt, die repräsentativ für die endgültige Aufgabe sind.

Reale Anwendungsfälle von generativer KI

Generative AI-Technologie hat eine riesige Bandbreite an Anwendungen in der realen Welt, von Text- und Bildgenerierung bis zur Softwareentwicklung. Schauen wir uns einige der derzeit gängigen Anwendungsfälle an.

Bildgenerierung

Tools wie DALL-E ermöglichen es Benutzern, neue Bilder (Fotos, Illustrationen und sogar Videos) durch Eingabe von visuellen oder schriftlichen Aufforderungen zu erstellen. Multimodale Modelle können Bilder aus Textanweisungen erstellen, sodass Benutzer so vage oder spezifisch sein können, wie sie möchten.

Zum Beispiel könnten Sie einfach um eine Zeichnung basierend auf "Tieren" und "Regenbögen" bitten und sehen, was dabei herauskommt. Oder Sie könnten detaillierte Anweisungen geben, wie zum Beispiel "ein Baby-Nashorn mit Sonnenbrille, das durch ein Fenster mit lila Vorhängen einen Regenbogen betrachtet."

Eine andere Option ist der Stiltransfer, bei dem der Inhalt eines Bildes mit dem visuellen Stil eines anderen kombiniert wird. Sie geben ein Inhaltsbild (ein Foto eines Nashorns) und ein Stilreferenzbild (ein Picasso-Gemälde) ein, und die KI ist in der Lage, sie zu mischen, um ein neues, Picasso-Stil Nashornbild zu erstellen.

Textgenerierung

Während eine der bekanntesten textbasierten GenAI-Anwendungen Chatbots sind, kann die Technologie nun für viele andere Aufgaben eingesetzt werden. Beispielsweise können Tools wie GrammarlyGo beim Verfassen und Beantworten von E-Mails in einem geschäftlichen Stil helfen.

Nehmen wir an, Sie müssten eine Broschüre erstellen, die ein technisches Produkt bewirbt. Als Mensch würden Sie sich Zeit nehmen, um die Funktionen und Spezifikationen zu lesen, detaillierte Notizen zu machen und einen Entwurf zu erstellen. Ein generatives KI-Programm kann all das in Sekunden tun, nachdem Sie die Informationen bereitgestellt haben, und schnell einsatzbereite Inhalte erstellen. Textgenerierung ist auch nützlich für die Synchronisation von Filmen, die Bereitstellung von Untertiteln für Videoinhalte oder die Übersetzung von Inhalten in verschiedene Sprachen.

Musikkomposition

GenAI ist in der Lage, Musik in einem bestimmten Genre zu schreiben oder den Stil bestimmter Komponisten nachzuahmen. Wie bei Bildgeneratoren können Sie Details angeben oder vollständige kreative Freiheit zulassen, zum Beispiel "Ein Lied über Regenbögen" oder "ein dreistrophiges Kinderlied über Regenbögen im Walzertakt, begleitet von Ukulele und Kazoo."

Sie können die KI auch bitten, zwei verschiedene Stücke mit Stiltransfer zu mischen, zum Beispiel das Geburtstagslied im Stil von Gershwin, oder einen Remix zu erstellen. Amper Music erstellt Musikstücke aus vorher aufgenommenen Samples, während andere Tools einen Soundtrack erstellen können, indem sie Objekte in Videomaterial erkennen.

Synthetische Daten

GenAI kann auch mithilfe fortschrittlicher Algorithmen und Simulationen synthetische Daten erzeugen. Diese künstlichen Datasets replizieren die statistischen Eigenschaften von realen Daten, ohne tatsächliche reale Information zu enthalten. Die herkömmliche Datenerhebung kann teuer und zeitaufwendig sein, liefert GenAI skalierbare Mengen an strukturierten und mit Labels versehenen Datensätzen zu einem Bruchteil der Kosten.

Zusätzlich zur Data Augmentation, die zur Verbesserung des KI-Modell Trainings verwendet wird, gehören zu den wichtigsten Use Cases für synthetische Daten:

- Forschung und Tests: Synthetische Daten von generativer KI können reale Umgebungen wie Finanzmärkte oder Wetterbedingungen simulieren, um Vorhersagemodelle und Produkte sicher zu testen.

- Datenschutz: Organisationen, die sensible Information in Branchen wie dem Gesundheitswesen und dem Finanzsektor handhaben, generieren synthetische Daten, die frei von personenbezogenen Daten (PII) sind, aber ihre statistische Relevanz beibehalten. Dadurch wird sichergestellt, dass die Daten sicher und genau analysiert werden können und gleichzeitig die Verbraucherschutzvorschriften eingehalten werden.

- Reduzierung von Bias: KI-Modelle, die mit realen Daten trainiert werden, übernehmen oft einen Bias, der zu unfairen Ergebnissen führt. Synthetische Daten können helfen, das gesamte Dataset auszubalancieren und sicherzustellen, dass die Daten die realen Gegebenheiten genauer und fairer abbilden.

Was sind die industriellen Anwendungen von generativer KI?

Mit so vielen Möglichkeiten, wie diese Technologie eingesetzt werden kann, ist es kein Wunder, dass generative KI für den Einzelhandel, Finanzdienstleistungen, Gesundheitswesen und mehr zur Norm statt zur Ausnahme wird.

Einzelhandel

Viele Einzelhandelsunternehmen nutzen bereits Chatbots, um den Kundenservice zu automatisieren und mit fortschreitender Entwicklung der generativen KI werden diese Chatbots immer ausgefeilter. In der Zukunft könnte KI eine weitere Personalisierung für Kunden mit virtuellen Anproberäumen, Produktentwicklung und proaktivem Marketing bieten. Einzelhandelsunternehmen könnten auch von der Verwendung von GenKI für die Bestands- und Nachfrageplanung sowie zur Identifizierung von Phishing oder Betrug für eine stärkere Sicherheit profitieren.

Finanzdienstleistungen

Unternehmen im Finanzdienstleistungssektor (FSI) investieren bereits in GenAI, um große Datenmengen zu analysieren. Ein Beispiel dafür ist das BloombergGPT LLM, das Anfang dieses Jahres angekündigt wurde. Das AI-Modell mit 50 Milliarden Parametern ist speziell für FSI-Berichterstattung und Prognosen konzipiert.

Weitere Anwendungen von generativer KI in der FSI, sowohl jetzt als auch in der Zukunft, umfassen Risikomanagement und Betrugserkennung, Verbesserung der betrieblichen Effizienz und Erhöhung der Kundenpersonalisierung.

Fertigung

Seit der Industriellen Revolution hat die Fertigungsindustrie versucht, die Effizienz durch Automatisierung zu optimieren. Generative KI bietet ein neues Werkzeug, das diese Industrie erneut in die Zukunft führen wird.

AI kann automatisierte Berichte über kontinuierliche Fertigungsprozesse liefern, Leistungslücken oder Engpässe identifizieren und datengesteuerte Priorisierung zur Steigerung der Effizienz nutzen. Neben der Überwachung von Operationen kann AI auch Geräte überwachen und Ausfallzeiten mit prädiktiver Wartung und Fehlerbehebung reduzieren.

Schließlich können LLMs in der Fertigung das Kundenerlebnis personalisieren, sowohl im Kundenservice als auch bei bestimmten Produkten, wie Fahrzeugen oder intelligenter Technologie.

Medien

Wie die Unterhaltungsindustrie KI nutzen wird, ist Gegenstand vieler aktueller Diskussionen. Es gibt jedoch viele Möglichkeiten, wie generative KI eingesetzt werden kann, ohne Arbeitsplätze in der Branche zu beeinträchtigen.

Die Analyse von Benutzerpräferenzen, Konsummustern und sozialen Mediensignalen durch KI-Modelle kann zur Optimierung von Medienempfehlungen von Unterhaltungsdiensten verwendet werden. GenAI-Modelle könnten auch gezielte Werbung verbessern. Die aufregendste Entwicklung in Bezug auf LLMs in der Unterhaltung ist jedoch das Potenzial für immersive, interaktive Geschichtenerzählung, bei der die Entscheidungen des Zuschauers die Erzählung formen würden.

Gesundheitswesen

Im Gesundheitswesen können generative AI-Modelle bei der Entdeckung neuer Medikamente helfen, indem sie Graphen erstellen, die neue chemische Verbindungen und Moleküle zeigen. AstraZeneca verwendet bereits AI für die Arzneimittelentdeckung und es wird geschätzt, dass bis 2025 mehr als 30% der neuen Arzneimittel und Materialien mit GenAI-Technologie entdeckt werden.

Diese Modelle können auch neue Verbindungen zum Testen vorschlagen, geeignete Versuchskandidaten identifizieren und medizinische Bildanalyseanwendungen mit synthetischen Bildern feinabstimmen. Darüber hinaus kann KI zur Erstellung personalisierter Behandlungspläne oder zur Transkription von Beratungen für den Upload in elektronische Gesundheitsakten verwendet werden.

Wie das Anwendungsspektrum der generativen KI Unternehmen zugute kommen kann

Wir haben einige der realen Anwendungen gesehen, aber was bedeutet generative KI für Unternehmen? Hier sind einige der wichtigsten Vorteile.

Einnahmequellen

Diese Technologie ermöglicht es Unternehmen, schnell neue Produkte zu erstellen und auf den Markt zu bringen, indem sie frische neue Designs entwickeln und den F&E-Prozess beschleunigen. Es kann Trends und Kundenverhalten analysieren, um neue Ideen für zusätzliche Einnahmequellen vorzustellen.

Neben der Produktinnovation kann KI Ihnen helfen, neue Marketingpläne zu erstellen und Werbematerialien zu produzieren. Durch die Analyse von Kundenvorlieben kann sie gezielte Werbung erstellen, Empfehlungen anpassen und Produkte und Dienstleistungen personalisieren. Die Datenanalyse durch KI hilft Unternehmen auch, Chancen zu erkennen, die sie vor ihren Konkurrenten halten und ihnen einen Wettbewerbsvorteil verschaffen.

Schließlich verbessert die Verwendung von GenAI die Leistung von Geschäfts-Chatbots, was die Kundenzufriedenheit, den Verkauf und die Bindung erhöht.

Produktivität

Ein weiterer großer Vorteil ist die Produktivität, da GenAI zur Automatisierung zeitaufwändiger manueller Aufgaben verwendet werden kann, wie zum Beispiel Dateneingabe, Routine-E-Mails und Transkriptionen von Meetings oder Anrufen.

AI-Modelle sind großartig darin, komplexe Informationen zusammenzufassen, was es Menschen erleichtert, sie zu verstehen und zu interpretieren. Es kann auch Ihre Daten analysieren und Vorschläge zur Verbesserung bestehender Workflows für maximale Effizienz machen.

Im Kundensupport können Unternehmen KI-gesteuerte Chatbots und virtuelle Assistenten einsetzen, um die Belastung der Support-Mitarbeiter zu reduzieren. Vorteile sind kürzere Antwort- und Lösungszeiten sowie die Möglichkeit für Agenten, andere Aufgaben zu erledigen, während die KI sich um häufige Anfragen kümmert.

Risikominderung

Generative KI-Plattformen können Ihnen eine tiefere Sicht auf Ihre Daten bieten und schnell finanzielle oder sicherheitsrelevante Schwachstellen identifizieren. Fortgeschrittene KI-Programme können sogar potenzielle Geschäftsrisiken simulieren, was Ihnen ermöglicht, die Einhaltung von Vorschriften zu bewerten und Protokolle zur Vermeidung oder Minderung von Problemen zu implementieren.

In der Zwischenzeit bedeutet Datenkompression, dass Organisationen nur wesentliche Daten speichern müssen, was das Risiko verringert, viele persönliche Informationen zu speichern.

Was sind die Unterschiede zwischen den gängigsten LLMs?

LLMs bilden ein überfülltes Feld und die Anzahl der Optionen wird weiter zunehmen. Allerdings können Sie LLMs im Allgemeinen in zwei Kategorien einteilen: proprietäre Dienste und Open-Source-Modelle. Schauen wir uns das genauer an.

Proprietäre Dienste

Der bekannteste LLM-Dienst ist ChatGPT, der Ende 2022 von OpenAI veröffentlicht wurde. ChatGPT bietet eine benutzerfreundliche Suchschnittstelle, die Aufforderungen akzeptiert und in der Regel schnelle und relevante Antworten liefert. Die ChatGPT-API ist auch für Entwickler zugänglich, die den LLM in ihre eigenen Anwendungen, Produkte oder Dienstleistungen integrieren können.

Andere proprietäre generative KI-Beispiele sind Google Bard und Claude von Anthropic.

Open-Source-Modelle

Der andere Typ von LLM ist Open Source und für kommerzielle Nutzung verfügbar. Die Open-Source-Community hat schnell die Leistung von proprietären Modellen erreicht und ihre Modelle, die selbst gehostet oder über Cloud-Service-APIs bereitgestellt werden können, können durch Feinabstimmung angepasst werden.

Beliebte Open-Source-LLMs sind Llama 2 von Meta und MPT von MosaicML, das von Databricks übernommen wurde.

Die beste generative KI LLM auswählen

Das Verständnis der Unterschiede zwischen proprietären und Open-Source-LLMs ist der erste Schritt, aber es gibt noch viel zu bedenken, wenn man ein LLM für GenAI-Anwendungen auswählt. Zukunftsorientierung, Kosten und die Nutzung von Daten als Wettbewerbsvorteil sollten alle berücksichtigt werden, wenn man sich zwischen einer geschlossenen API eines Drittanbieters oder einem Open-Source (oder fein abgestimmten) LLM entscheidet.

Während proprietäre LLM-Dienste oft sehr leistungsfähig sind, können sie auch Governance-Bedenken aufwerfen, da ihr "Black-Box"-Stil weniger Aufsicht über ihre Trainingsprozesse und Gewichte zulässt. Ein weiteres Risiko besteht darin, dass proprietäre Modelle eingestellt oder entfernt werden können, was bestehende Pipelines oder Vektorindizes unterbrechen würde.

Andererseits sind Open-Source-Modelle dem Käufer unbegrenzt zugänglich. Diese Modelle bieten auch mehr Anpassungsmöglichkeiten und Kontrolle, was zu besseren Leistungs-Kosten-Abwägungen führen kann. Schließlich können Organisationen mit zukünftiger Feinabstimmung von Open-Source-Modellen ihre Daten als Wettbewerbsvorteil nutzen, um bessere Modelle zu erstellen als öffentlich verfügbar sind.

Warum gibt es Bedenken hinsichtlich der Ethik der generativen KI?

Jede Form von KI wirft in der Regel ethische Bedenken auf, da Menschen mit den Implikationen von intelligenten Maschinen ringen. Also, was sind die Ethik der generativen KI? Zunächst einmal ist diese Technologie relativ neu und entwickelt sich auch sehr schnell. Selbst Entwickler in diesem Bereich sind sich nicht ganz sicher, wo es enden wird, aber da Modelle lernen, menschenähnlichere Antworten zu produzieren, wird es immer schwieriger, Ungenauigkeiten zu erkennen.

Ein Problem, das bei GenAI-Modellen identifiziert wurde, sind "Halluzinationen". Dies ist der Moment, in dem Chatbots im Grunde Dinge erfinden. Dies kann ernsthafte Folgen haben, wenn ein Modell für Dinge wie medizinische Beratung oder genaue Berichterstattung verwendet wird.

Darüber hinaus können, wenn unbewusste oder absichtliche Vorurteile, wie Rassismus oder Homophobie, in Trainingsdatensätzen enthalten sind, diese in Modelle kodiert werden und den Ausstoß einer KI beeinflussen.

Abgesehen von Fehlinformationen oder potenziell schädlichen Inhalten gibt es eine allgemeine Sorge um "Deepfakes" - digital gefälschte Bilder oder Videos. Cyber-Angreifer können auch generative KI verwenden, um den Stil eines vertrauenswürdigen Absenders zu imitieren und Nachrichten zu schreiben, die nach Passwörtern oder Geld fragen.

Darüber hinaus ist es oft schwierig, die Ausgaben von Modellen auf Autoren zurückzuführen, was Urheberrechts- und Plagiatsprobleme schafft. Dies wird durch den Mangel an Informationen über bestimmte Datensätze weiter kompliziert - zum Beispiel können Benutzer bei Bildgenerierungstools etwas "im Stil von Künstler X" anfordern, wenn "Künstler X" nie zugestimmt hat, dass seine Bilder Teil eines Datensatzes sind.

Weitere Bedenken hinsichtlich GenAI und Ethik beinhalten die Nachhaltigkeit, da die Technologie enorme Rechenleistung und Strom benötigt, sowie die Möglichkeit, dass sie Behauptungen, dass echte Berichterstattung gefälscht ist, durch das Fördern von Misstrauen gegenüber Wörtern und Bildern im Internet Glaubwürdigkeit verleiht.

Wie können Sie die Qualität von AI testen?

Wie wir im vorherigen Abschnitt erwähnt haben, kann generative KI manchmal ungenaue oder minderwertige Ergebnisse liefern. Wenn Sie generative KI-Tools und -Frameworks erforschen, werden Leistungskennzahlen in den Verkaufsunterlagen angezeigt, aber es ist immer am besten, selbst zu überprüfen.

Entwickler und Ingenieure sollten KI-generierte Inhalte auf Qualität und Vielfalt testen, um sicherzustellen, dass das Modell so funktioniert, wie es trainiert wurde. Es ist relativ einfach zu sehen, ob es eine fehlerhafte "faktische" Aussage gibt - aber es ist schwieriger, die Qualität von künstlerischen oder kreativen Outputs zu bewerten, die subjektiv sind.

Tools wie die MLflow-Bewertungs-API von Databricks können verwendet werden, um GenKI-Parameter und -Modelle zu verfolgen und zu sehen, ob die Ausgaben für Ihre Bedürfnisse ausreichend sind. Dies kann auch mit menschlicher Bewertung kombiniert werden - zum Beispiel, indem Sie Ihr eigenes Urteil verwenden, um zu beurteilen, ob ein generiertes Musikstück oder Kunstwerk ansprechend ist. Objektivere Bewertungsmetriken umfassen den Inception-Score, die Fréchet Inception Distance (FID) und die Ground Truth.

Grundwahrheit

Diese Bewertungsmethode beinhaltet die Identifizierung der Ground Truth, auf der die generative KI trainiert wurde. Ground Truth ist im Grunde die "korrekte" Antwort auf eine Anfrage, basierend auf Informationen, die als faktisch wahr bekannt sind. Sie sollte in den Trainingsdatensätzen enthalten sein, die der KI beibringen, wie sie zu einem zuverlässigen Ausgang gelangt.

Wenn Sie beispielsweise ein Modell trainieren würden, um ungenaue Inhalte zu erkennen, bräuchten Sie einen großen Datensatz mit Texten und Bildern, die als wahr oder falsch klassifiziert wurden. Entwickler können die Genauigkeit der Antworten und Vorhersagen messen, indem sie diesen Datensatz als Standard nehmen.

Da jedoch KI-Designer diejenigen sind, die die Grundwahrheit konstruieren, sind Sie auf ihre Sorgfalt angewiesen, um sicherzustellen, dass die Informationen korrekt sind. Idealerweise kommt Ihre Grundwahrheit direkt von Ihren Benutzern als Feedback.

Databricks Lakehouse Monitoring kann KI-Profis dabei helfen, sicherzustellen, dass ihre Assets hochwertig, genau und zuverlässig sind. Proaktive Berichterstattung und einheitliche Werkzeuge bieten vollständige Sichtbarkeit von Daten und Modellen für eine einfache Erkennung von Anomalien, und eingebaute Modell-als-Richter-Metriken können mit Ihren benutzerdefinierten Qualitätsmetriken ergänzt werden.

AI-Qualitätsmetriken

KI-Qualitätsmetriken sind Messungen, die zur Bestimmung der Leistung eines generativen KI-Modells verwendet werden. Neben traditionellen ML-Metriken wie Genauigkeit und Abruf, ermöglichen spezifische Metriken für GenAI eine wichtige Bewertung dieser Modelle.

Zum Beispiel bewertet die Fréchet Inception Distance (FID) Metrik die Qualität von Bildern, die von generativer AI erstellt wurden. Durch den Vergleich der Verteilung der generierten Bilder mit der der echten Bilder, die zum Training des Tools verwendet wurden, kann der Abstand zwischen der Verteilung der Aktivierungen für einige tiefe Schichten in einem Klassifikator berechnet werden. Ein Score von 0.0 ist das beste Ergebnis für die FID.

Databricks hat den Wert der Verwendung von LLMs als Richter für die Qualität von Chatbots gezeigt. Diese hochmodernen Techniken haben zur neuen MLflow-Modell-als-Richter-Funktionalität geführt, die den Textausgang von verschiedenen KI-Modellen vergleichen kann, um Toxizität und Perplexität zu bewerten.

Aktuelle Herausforderungen der generativen KI

Obwohl die Technologie sich schnell entwickelt, gibt es immer noch erhebliche Herausforderungen bei der Verwendung von generativen KI-Modellen.

Skalierung der Infrastruktur

Eine der Haupt Herausforderungen bei der erfolgreichen Implementierung von GenAI ist die Skalierbarkeit. Wie wir gelernt haben, benötigen diese Modelle eine große Menge an hochwertigen und unvoreingenommenen Daten, um die gewünschten Ausgaben zu erzeugen.

Für die Entwicklung und Wartung von generativen KI-Modellen ist eine groß angelegte Recheninfrastruktur und Leistung erforderlich, was wiederum erhebliche Kapitalausgaben und technisches Know-how erfordert. Dies hat zu einer wachsenden Nachfrage nach skalierbaren Lösungen geführt.

Optimierungskomplexitäten

Praktiker des Machine learning können auch mit einer Reihe von Low-Level-Herausforderungen konfrontiert sein, die sich aus der Notwendigkeit ergeben, generative KI-Modelle zu optimieren. Beispiele für diese Komplexitäten sind unter anderem Mode Collapse und Vanishing Gradients.

Mode Collapse ist ein Fehlertyp bei GANs, bei dem der Generator statt vielfältiger Ausgaben immer wieder eine glaubwürdige Ausgabe produziert, die der Diskriminator akzeptiert. Wenn der Diskriminator nicht lernt, ähnliche, wiederholte Ausgaben abzulehnen, rotiert der Generator in jeder weiteren Iteration nur durch eine kleine Auswahl an Ausgabetypen.

Verschwindende Gradienten können auftreten, wenn neuronale Netze um zusätzliche Schichten mit bestimmten Aktivierungsfunktionen erweitert werden und der Gradient der Verlustfunktion dadurch zu klein wird. Ein zu kleiner Gradient verhindert, dass die Gewichtungen und Biases der Anfangsschichten richtig aktualisiert werden, wodurch Key-Elemente der Erkennung von Eingabedaten fehlschlagen und das Netzwerk ungenau wird.

Eine besondere Herausforderung in Generative AI ist das Anpassen großer Foundation-Modelle an unternehmensspezifische Tasks, ohne teure Annotationen oder mehrfache Fine-Tuning-Iterationen. Ein neuer Ansatz ist die Test-time Adaptive Optimization (TAO), die vom Databricks Mosaic AI Research-Team entwickelt wurde. Sie nutzt ungekennzeichnete Eingaben, Test-Time-Compute (Rechenaufwand zur Laufzeit) und Reinforcement Learning, um Modelle effizient abzustimmen, ohne die Inferenzkosten zu erhöhen.

Unzusammenhängende Daten, ML und KI-Tools

Isolierte, schlecht integrierte Tools für Daten, klassisches Machine Learning und generative KI können auch für Data Scientists eine Herausforderung darstellen.

Hochwertige Daten sind für das Training von machine learning- und GenAI-Modellen unerlässlich, und die Ausgaben von ML- und GenAI-Modellen müssen wieder in die Datenpipeline eingespeist werden. Governance, Qualität und Implementierung müssen für Daten und ML/KI ganzheitlich gedacht werden. Getrennte Plattformen führen sonst zu Reibungsverlusten, Ineffizienz und zusätzlichen Kosten für Unternehmen.

Die Databricks Data Intelligence Platform unterstützt zentrale Daten-Workloads, klassisches ML und generative KI und versteht die Datennutzung durchgängig. Durch die Kombination der offenen, einheitlichen Lakehouse-Architektur mit generativer KI optimiert die Data Intelligence Platform die Performance, vereinfacht die User Experience und bietet eine starke und sichere Governance und Datenschutz.

Das Model Context Protocol (MCP) adressiert diese Herausforderung, indem es LLMs eine sichere, standardisierte Möglichkeit bietet, auf die Daten und Tools zuzugreifen, die sie für den Einsatz im Unternehmenskontext benötigen. Als offenes Protokoll zum Aufbau zweiseitiger Verbindungen zwischen KI-Assistenten und Datensystemen ermöglicht MCP es Agents, Funktionen aufzurufen, Wissen abzurufen und sich in Pipelines zu integrieren, ohne neue Silos zu schaffen. Auf Databricks wird MCP mit Mosaic AI für die Erstellung und Evaluierung von Agenten und Unity Catalog für die Governance gekoppelt. So erhalten Unternehmen KI mit Kontext, bei gewährleisteter Sicherheit und Beobachtbarkeit.

Wie wird die Zukunft der generativen KI aussehen?

Laut Gartner wird die generative KI eine ähnliche Wirkung haben wie die Dampfmaschine, Elektrizität und das Internet und schließlich zu einer "allgemeinen Technologie" werden. Das liegt daran, dass es so viele potenzielle Anwendungen für die Technologie gibt.

Zum Beispiel könnten Aktivitäten, die derzeit bis zu 30% der Arbeitsstunden in der US-Wirtschaft ausmachen, bis 2030 automatisiert werden. Wir werden auch eine Zunahme von Softwareanbietern sehen, die KI-Fähigkeiten in ihre Tools integrieren.

Verständlicherweise machen sich Menschen Sorgen, ihre Arbeitsplätze an Maschinen zu verlieren, aber die Zukunft der KI könnte auch viele neue Arbeitsplätze schaffen. Zum Beispiel müssen Menschen immer noch GenAI-Systeme entwickeln und trainieren, einschließlich der Auswahl des am besten geeigneten Modells für eine bestimmte Aufgabe und der Sammlung von Trainingsdaten zur Bewertung der Ausgaben.

Die schnelle Einführung von Technologien wie ChatGPT unterstreicht die Herausforderungen bei der verantwortungsvollen Nutzung von GenAI. Länder und Staaten stellen bereits fest, dass sie neue rechtliche und sicherheitsrelevante Protokolle benötigen, um Probleme im Zusammenhang mit Urheberrecht und Bedrohungen für die Cybersicherheit zu bewältigen, und diese Technologien werden in Zukunft wahrscheinlich stärker reguliert.

In der Zwischenzeit hat die Databricks Data Intelligence Plattform generatives AI integriert - was es einfacher macht, Datensicherheit und -governance zu gewährleisten, sowie die Datenqualität zu überwachen und Ihre Modelle zu optimieren.

Da die Architekturen und Trainingsalgorithmen fortschrittlicher werden, werden generative AI-Modelle leistungsfähiger. Organisationen müssen sich daran erinnern, dass mit Macht Verantwortung einhergeht, und sie müssen das Gleichgewicht zwischen Automatisierung und menschlicher Beteiligung finden.

Wo kann ich mehr Informationen über generative KI finden?

Es gibt viele Ressourcen, um mehr Informationen über generative AI zu finden, einschließlich dieser:

Weiterbildung

- Grundlagen der generativen KI: Nehmen Sie diesen kostenlosen Kurs von Databricks und lernen Sie die Grundlagen der generativen KI kennen.

- LLMs: Lernen Sie Foundation Models von Grund auf kennen (edX und Databricks Training). Dieses kostenlose Training von Databricks geht ins Detail der Foundation Models in LLMs.

- LLMs: Verbessern Sie Ihre Fähigkeiten mit dem Kurs Application Through Production (edX und Databricks Training). Dieses kostenlose Training von Databricks konzentriert sich darauf, wie man LLM-fokussierte Anwendungen mit den neuesten und bekanntesten Frameworks erstellt.

Seiten

- Databricks AI und Machine Learning Seite

E-Books

- Die große Beschleunigung: CIO-Perspektiven auf generative KI: Lesen Sie diesen Bericht von MIT Technology Review, der Einblicke von über 600 CIOs in generative KI bietet.

- Definieren Sie mit Generativer KI neu, was möglich ist: Beginnen Sie mit 52 Anwendungsfällen

- Das Big Book zu MLOps

Technische Blogs

- Erstellen hochwertiger RAG-Anwendungen mit Databricks

- Best Practices für die LLM-Bewertung von Retrieval Augmented Generation (RAG) Anwendungen

- Mit MLflow AI Gateway und Llama 2 generative AI-Apps erstellen (Erzielen Sie eine höhere Genauigkeit mit RAG und Ihren eigenen Daten)

- Implementieren Sie Ihren LLM-Chatbot mit Retrieval Augmented Generation (RAG), Foundation Models und Vector Search

- LLMOps: Alles was Sie zum Verwalten von LLMs wissen müssen

Sie können auch Databricks kontaktieren, um eine Demo zu vereinbaren und mit jemandem über Ihre LLM-Projekte zu sprechen oder mehr über Databricks' Angebote für LLMs zu lesen.