데이터 인텔리전스 및 AI 트렌드: 인기 제품, RAG 등

데이터 및 AI 전략을 위한 플레이북

인공지능의 열기는 식을 기미가 보이지 않습니다. 강력한 GenAI 전략을 실행해야 한다는 압박과 기대감이 커지면서 데이터 리더와 실무자들은 이를 달성하는 데 도움이 되는 최고의 플랫폼, 도구, 사용 사례를 찾고 있습니다.

실제 세계에서는 어떻게 진행되고 있나요? 최근 10,000개의 글로벌 고객의 데이터를 활용하여 다양한 산업 분야의 조직이 AI에 어떻게 접근하고 있는지 파악하기 위해 2024 데이터 + AI 현황 보고서를 발표했습니다. 이번 보고서에서는 모든 데이터 기반 기업과 관련된 광범위한 주제를 다루고 있지만, GenAI의 여정에서 분명한 트렌드가 나타났습니다.

다음은 발견 항목에 대한 스냅샷입니다.

상위 10개 데이터 및 AI 제품: GenAI 스택이 형성되고 있습니다.

새로운 기술이 나오면 개발자는 다양한 도구를 사용해 자신에게 가장 적합한 것을 실험을 통해 파악합니다.

데이터브릭스 데이터 인텔리전스 플랫폼에서 가장 널리 채택된 통합 기능을 소개하는 데이터 및 AI 제품 상위 10가지입니다. 데이터 통합에서 모델 개발에 이르기까지, 이 목록은 기업들이 새로운 GenAI 우선순위를 지원하기 위해 스택에 어떻게 투자하고 있는지 보여줍니다:

Hugging Face 트랜스포머가 2번으로 점프

단 12개월 만에 Hugging Face 순위가 4위에서 2위로 뛰어올랐습니다. 많은 기업이 오픈 소스 플랫폼의 트랜스포머 모델을 엔터프라이즈 데이터와 함께 사용하여 기초 모델을 구축하고 미세 조정합니다.

통합 후 몇 달 만에 최고의 제품이 된 LangChain

자체 LLM을 작업하고 구축하기 위한 오픈 소스 도구인 LangChain은 통합 1년 만에 4위로 올라섰습니다. 기업이 자체적으로 최신 LLM 애플리케이션을 구축하고 특수한 트랜스포머 관련 Python 라이브러리를 사용하여 모델을 훈련할 때, LangChain을 사용하면 프롬프트 인터페이스를 쉽게 개발하고 다른 시스템과 통합할 수 있습니다.

엔터프라이즈 GenAI의 관심은 LLM 커스터마이징

작년에 가장 인기 있는 LLM Python 라이브러리를 분석한 결과, 2023년의 "대세" 도구로 SaaS LLM이 선정된 바 있습니다. 올해 데이터에 따르면 범용 LLM의 사용은 계속되고 있지만 전년 대비 성장세는 둔화되고 있습니다.

올해 전략은 큰 변화를 맞이했습니다. 데이터에 따르면 기업들은 독립형 기성 LLM을 사용하는 것보다 맞춤형 데이터로 LLM을 보강하는 데 집��중하고 있는 것으로 나타났습니다.

기업은 SaaS LLM의 강력한 기능을 활용하는 동시에 정확도를 개선하고 기본 모델을 더 잘 작동하도록 조정하기를 원합니다. RAG를 사용하면 기업은 직원 핸드북이나 자체 재무제표와 같은 것을 사용하여 비즈니스에 특화된 결과물을 생성할 수 있습니다. 그리고 이러한 맞춤형 시스템을 구축하고자 하는 고객들의 수요는 매우 높습니다. RAG 모델의 핵심 구성 요소인 벡터 데이터베이스의 사용은 작년에 377% 증가했으며, Databricks Vector Search가 공개 프리뷰에 들어간 후 186% 증가한 것을 포함합니다.

엔터프라이즈 AI 전략과 개방형 LLM

기업이 기술 스택을 구축함에 따라 오픈소스는 그 존재감을 드러내고 있습니다. 실제로 상위 10개 제품 중 9개 제품이 오픈 소스이며, 여기에는 GenAI의 두 주요 제품인 Hugging Face 과 LangChain 이 포함됩니다.

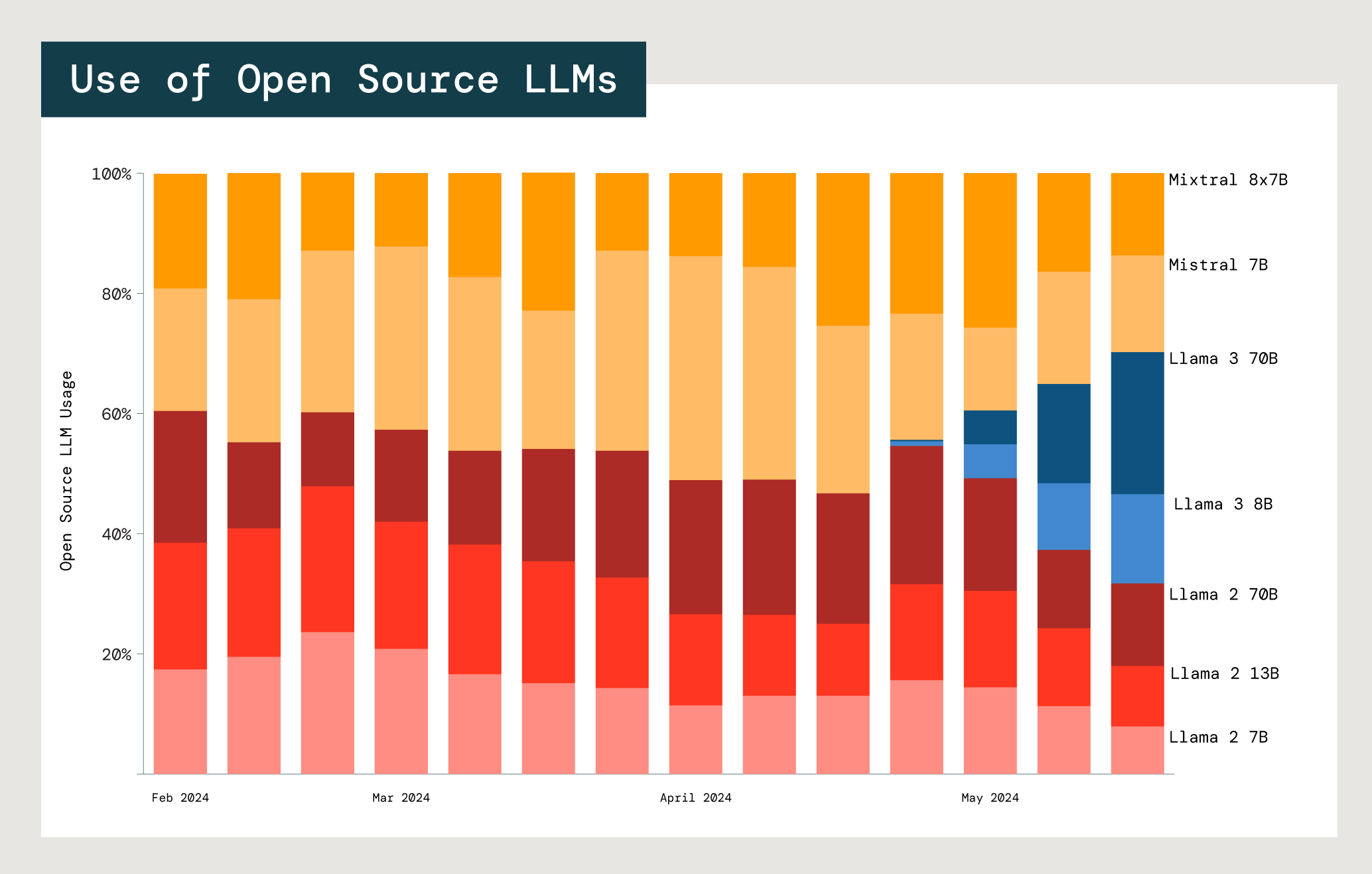

또한 오픈 소스 LLM은 조직의 고유한 요구 사항과 사용 사례에 맞게 커스터마이즈할 수 있는 기능 등 많은 엔터프라이즈 이점을 제공합니다. 우리는 기업들이 어떤 모델을 선호하는지 파악하기 위해 두 주요 모델인 Meta Llama 와 Mistral 의 오픈소스 모델 사용 현황을 분석했습니다.

각 모델에는 비용, 지연 시간, 성능 간의 절충점(trade-off)이 있습니다. 가장 작은 메타 Llama 2 모델(7B 및 13B)의 사용량이 가장 큰 메타 Llama 2 70B보다 훨씬 높습니다.

Llama와 Mistral 사용자 전체에서 77%가 13B 매개변수 이하의 모델을 선택했습니다. 이는 기업들이 비용과 지연 시간에 상당한 관심을 가지고 있음을 시사합니다.

2024 데이터 + AI 현황 보고서에서 이러한 트렌드와 기타 트렌드에 대해 자세히 알아보세요. 효과적인 데이터 및 AI 전략을 위한 플레이북이라고 생각하세요. 다음 링크에서 보고서 전문을 다운로드할 수 있습니다.

(번역: Eunwoo Kim) Original Post