Databricks AIセキュリティフレームワーク(DASF)の紹介

AIのセキュリティを管理するための実用的なフレームワーク

Databricks AI Security Framework(DASF)バージョン1.0のホワイトペーパーを発表できることを嬉しく思います! このフレームワークは、ビジネス、IT、データ、AI、セキュリティの各グループのチームワークを向上させるように設計されています。 本書は、実際の��攻撃観察に基づくAIセキュリティリスクの知識ベースをカタログ化することで、AIとMLの概念を簡素化し、AIセキュリティに対する徹底的な防御アプローチを提供するとともに、すぐに適用できる実践的なアドバイスを提供します。

機械学習(ML)と生成AI(GenAI)は、イノベーション、競争力、従業員の生産性を高めることで、仕事の未来を変革します。 しかし、企業は人工知能(AI)技術を活用してビジネスチャンスを得ると同時に、データ漏洩や法規制の不遵守など、潜在的なセキュリティおよびプライバシーリスクを管理するという二重の課題に取り組んでいます。

このブログでは、DASFの概要、組織のAIイニシアチブを保護するためにDASFを活用する方法、DASFの対外的な勢いに関する最新情報をお伝えし、組織におけるAIの導入を安全にガイドします。

Databricks AIセキュリティフレームワークの基盤の構築

AIはあらゆる産業に影響を与え、私たちの働き方を変えています。 今、リーダーはこれまで以上にデータとAIを活用して組織を変革したいと考えています。 AIセキュリティとガバナンスは、組織のAI目標に対する信頼を確立するために不可欠です。 ガートナーによると、AIの信頼性、リスク、セキュリティ管理は、ビジネスとテクノロジーの意思決定に影響を与える2024年のトップ戦略トレンドの第1位であり、2026年までに、AIの透明性、信頼性、セキュリティを運用化する組織のAIモデルは、採用、ビジネス目標、ユーザー受容性の点で50%増を達成するとのことです。

今年の初め、私たちはDatabrickによるMosaicMLの買収を発表し、Responsible AIに対する私たちのコミットメントについて詳しくお伝えしました。 この数ヶ月間、私たちは新たなパートナーシップを通じて、AIの業界リーダーとしてのコミットメントと勢いをさらに強化してきました。 これらの投資を補完するために、Databricksのセキュリティチームは現在、CISO向けにAIセキュリティワークショップを開催しています。 私たちはお客様から、セキュリティとガバナンスのチームが、AIとは何か、どのように機能するのか、これらの技術が展開されるときにどのようなセキュリティリスクが発生する可能性があるのかを解明する信頼できる資料を見つけるのに苦労していることを学びました。

DASFフレームワークは、ビジネス、IT、データ、AI、セキュリティの各チームが、以下の原則の下、AIの導入においてより良い協力関係を築けるよう支援するものです:

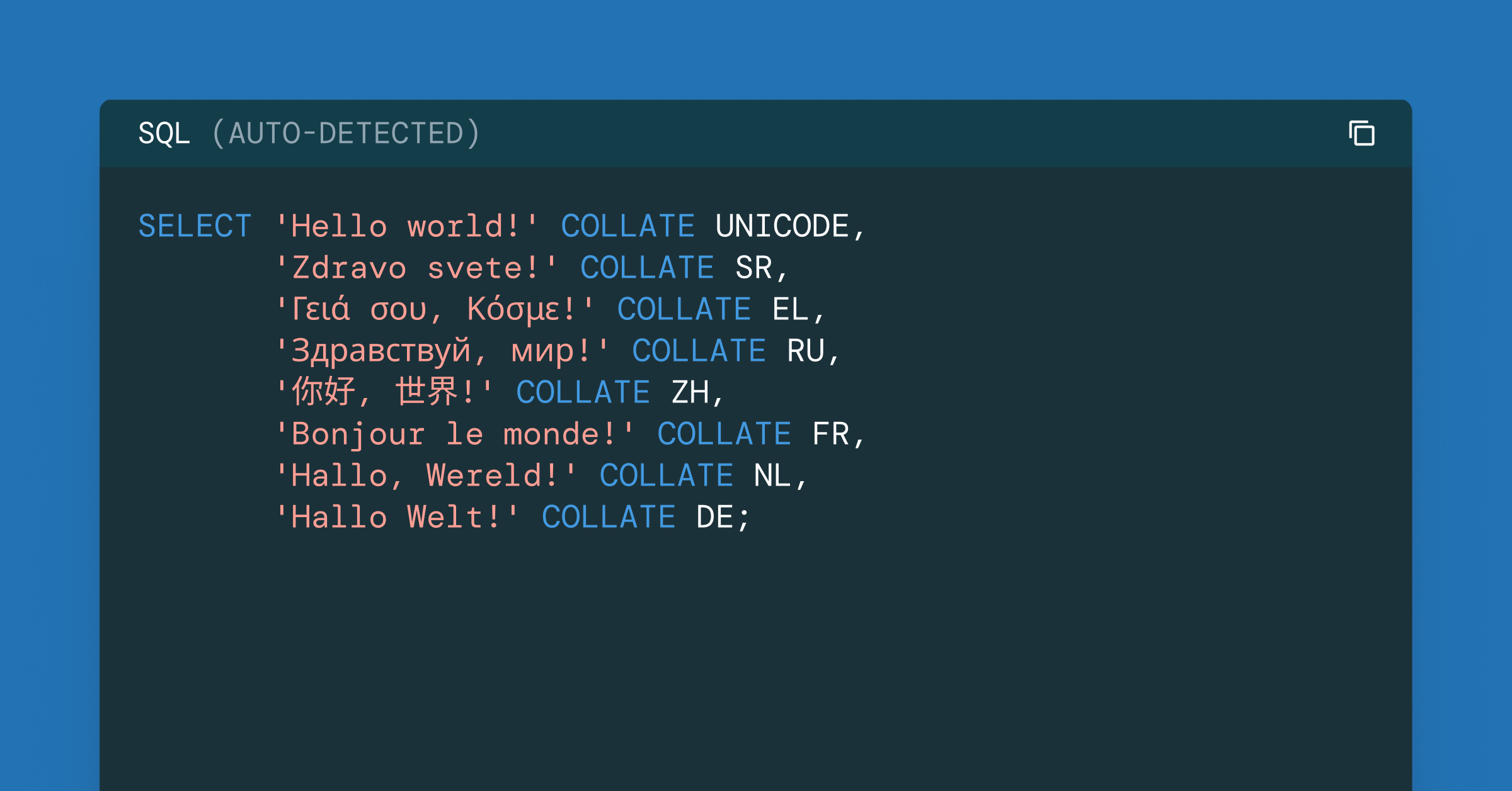

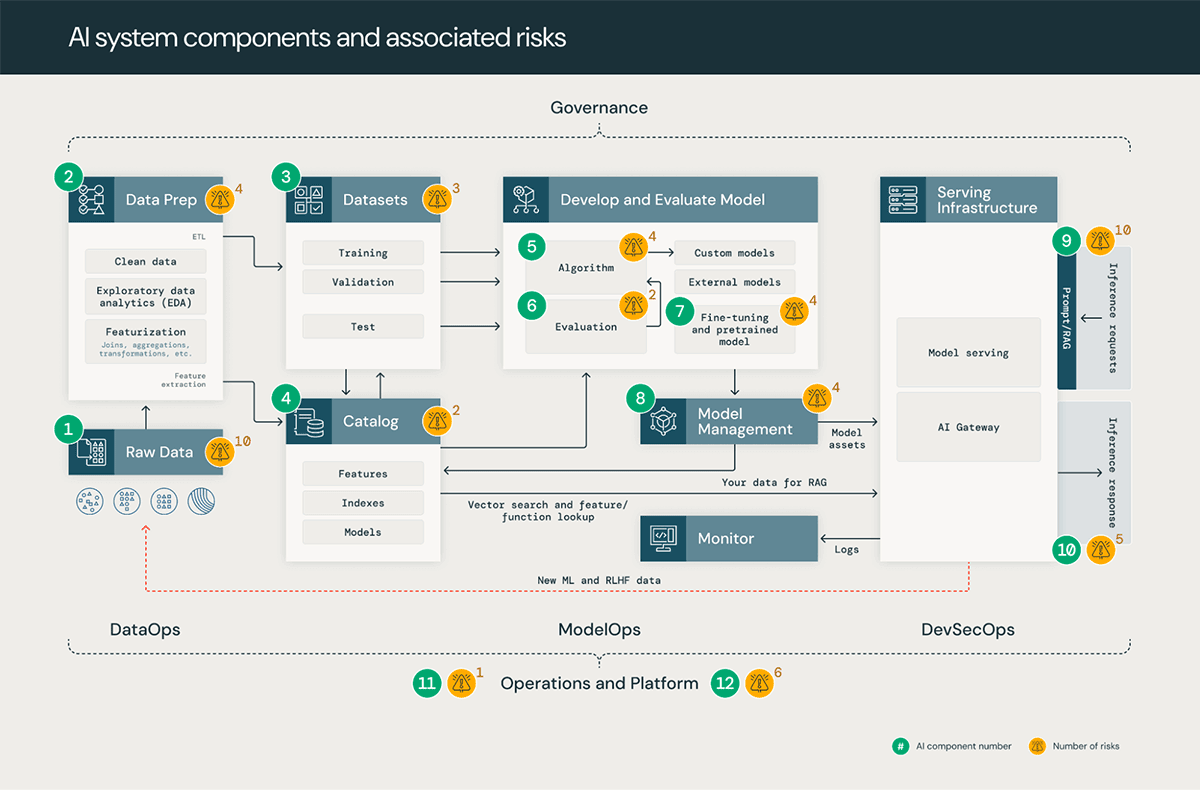

- AIとMLを解明:DASFはAIシステムの12の構成要素、どのようなAIモデルが存在するのか、そしてそれらがどのように連携するのかを解説します。 これは、関係�するAIシステム、プロセス、ペルソナの共通の命名法を定義することで、チームの共同作業に役立ちます。

- AIを保護するための徹底的な防御アプローチを提供する:セキュリティリーダーとの対話では、AIセキュリティがサイバーセキュリティの問題なのか、敵対的な機械学習の問題なのか、それともまったく新しいものなのかを明確にする必要があります。 現実は上記のすべてです。 DASFは、特定のAIユースケースと導入モデルに基づいて、あらゆるAIシステムの3つの段階にわたる55のセキュリティリスクを理解するためのフレームワークを提供します。 また、MITRE ATLAS、OWASP Top 10 for LLMs、NIST AML Taxonomyなどの一般的なAIセキュリティフレームワークにリスクをマッピングします。

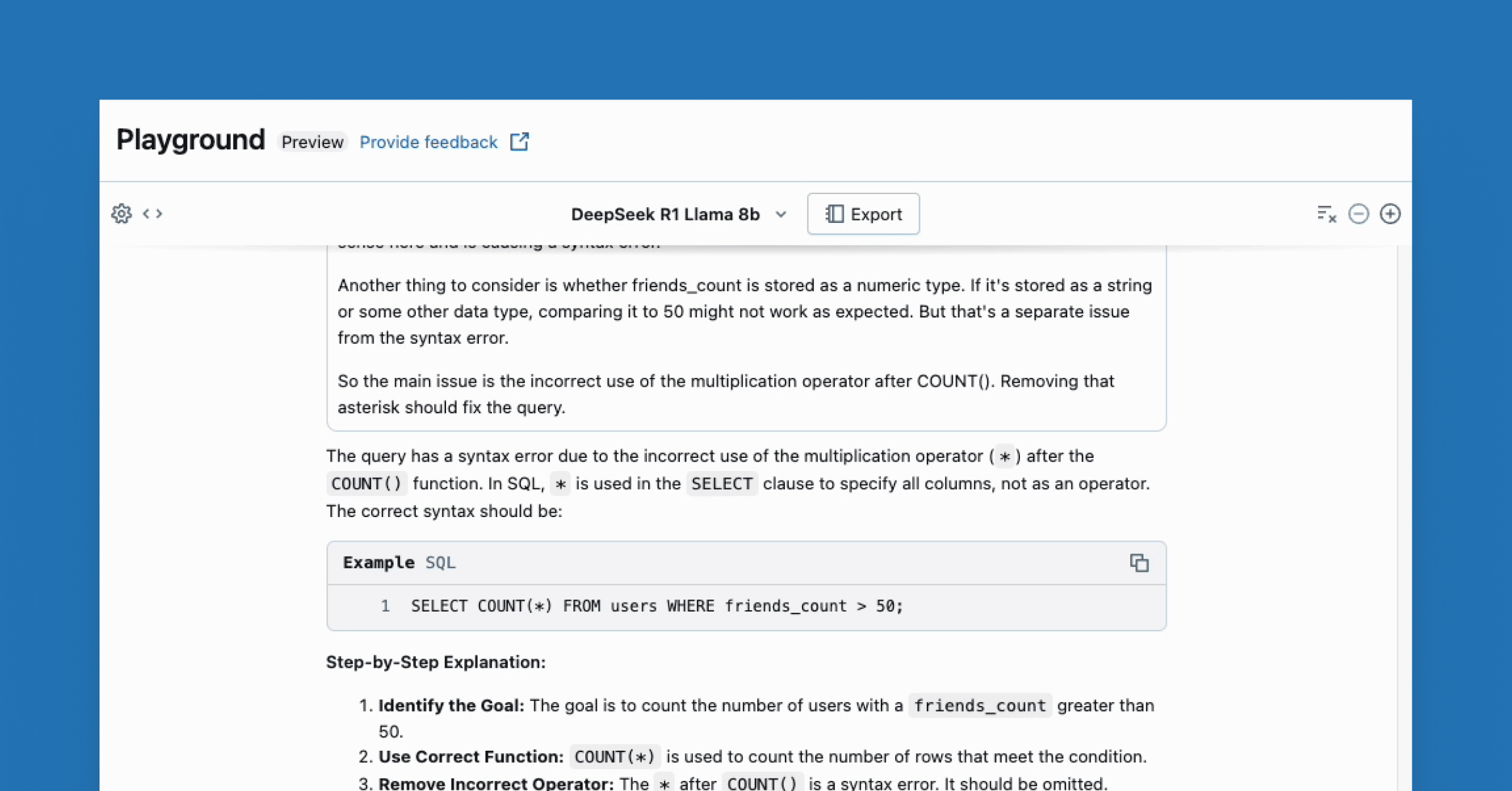

- 実行可能な推奨事項の提供:既存のフレームワークの多くは、AIに関連するリスクをうまく概説していますが、それを軽減するために必要なコントロールの概要を明確に示していません。 DASF は、どのようなデータおよび AI プラットフォームにも適用できる 53 の管理策を推奨しています。 Databricks をご利用のお客様には、さらに一歩踏み込んで、Databricks のドキュメント(クラウド別)へのリンクを掲載し、それぞれの緩和的な制御の具体的な実装方法を説明します!

Databricks AIセキュリティフレームワークの使用開始

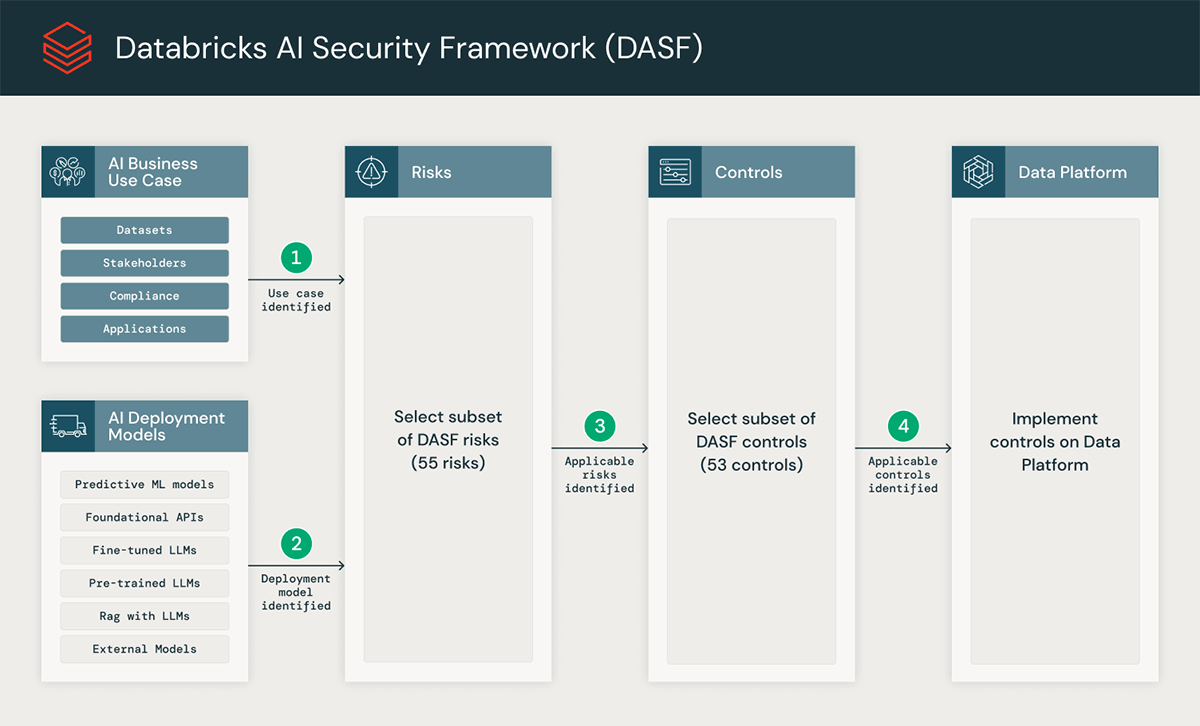

DASFは、どのようなデータおよびAIプラットフォームを使用する場合でも、組織のAI導入ニーズに対応したエンドツーエンドのリスクプロファイルと、導入を検討すべき具体的な管理策を得ることができるように設計されています。 DASFを使い始めるには、下図のようなアプローチをお勧めします:

ステップ1 - AIビジネスのユースケースの特定:すでに導入済みであるか計画段階であるかにかかわらず、組織のAIユースケースについてステークホルダーと協力してください。 Databricksソリューションアクセラレーターを活用することをお勧めします。これは、最も一般的で��インパクトの大きいAIおよびMLのユースケースにおいて、結果をスピードアップするための専用ガイドです。 どのようなデータセットが使用されるのか、どのようなコンプライアンス要件が適用されるのか、AIシステムがどのようなアプリケーションに影響を与えるのかを検討し、データとAIプラットフォームに求められる基本的な機能を導き出します。

ステップ2 - AI導入モデルの決定:予測MLモデル、RAG-LLM、微調整LLM、事前学習済みLLM、基盤モデル、外部モデルなど、適切な導入モデルを選択します。 各展開モデルには、12のAIシステム・コンポーネント、組織、データ、AIプラットフォーム、および関係するパートナー間で、さまざまな分担責任があります。

ステップ 3 - 最も適切なリスクの選択:文書化された 55 のセキュリティリスク一覧から、組織が実装しようとしているユースケースと展開モデルに基づいて、組織に最も関連性の高いリスクを特定します。 ほとんどのユースケースでは、55のリスクのうち対処が必要なのはごく一部です。

ステップ 4 - コントロールの選択と実施:組織のリスク選好度に沿った管理策を選択します。 これらのコントロールは、どのようなデータやAIプラットフォームとも互換性があるように汎用的に定義されています。 また、Databricksのフレームワークでは、これらのコントロールを Databricksデータインテリジェンスプラットフォーム専用に調整するためのガイドラインを、クラウド別の具体的なDatabricks導入ガイダンスとともに提供しています。 ��組織のポリシーと並行してこれらのコントロールを使用し、適切な保証を行います。

それでもまだ多いと感じられる方には、対話型の体験を希望される方のために、AIセキュリティ・ワークショップを引き続き開催します。

業界の同盟、パートナー、顧客を通じたAIセキュリティの育成

セキュリティ業界では、集団の安全、安心、成功を確保するために、同業者間の協力関係を育むことが不可欠です。 安全なAIシステム開発のためのガイドライン」、「NIST AIリスクマネジメントフレームワーク」、「AI向けサイバーセキュリティ対策のためのマルチレイヤーフレームワーク」など、先行している標準、フレームワーク、サードパーティツールがなければ、今日のDASFのような文書を発表することはできなかったでしょう。 DASFには他にも多くの資料が掲載されており、リソースセクションで確認することができます。

私たちはDatabricksのAI、ML、セキュリティの専門家と数え切れないほどの社内レビューを行いましたが、HITRUST、カーネギーメロン大学、Capital One、Protect AI、バラクーダを含む15人のAIセキュリティ業界のリーダーとも会いました(以下、さらに引用!)。 DASFを同業者にとって最も実用的なものにするための時間、洞察、フィードバックに感謝します。 査読者のリストは、DASFの謝辞欄に掲載されています。

"良いアクセラレーターとは何かを考えるとき、それは物事をよりスムーズに、より効率的にし、イノベーションを促進することです。 DASFは、パートナーがAIを最大限に活用できるよう、セキュリティチームが支援するための実証済みの効果的なツールです。 さらに、NISTのような確立されたリスクフレームワークにも対応しているため、単にスピードアップを図るだけでなく、セキュリティ業務の基礎を固めることができます。" - ネイビー・フェデラル・クレジット・ユニオン、情報セキュリティ担当副社長、リヤズ・プーナワラ氏

"企業はAIイノベーションのためにセキュリティを犠牲にする必要はありません。 Databricks AIセキュリティフレームワークは、AIを安全に導入するための包括的なツールです。 AIセキュリティの懸念��をAI開発パイプラインにマッピングするだけでなく、Databricksの顧客にとって実用的なコントロールで実行可能なものにします。 この貴重な地域資源の発展に貢献できたことを嬉しく思います。" - ロバスト・インテリジェンス、CTO、ハイラム・アンダーソン氏

"DASFは、AIにおけるデータブリックのリーダーシップを示す好例であり、重要な時期にある業界への貴重な貢献です。 私たちは、人工知能に関連する当面の最大のリスクは悪人であることを知っており、このフレームワークは、そうしたサイバー犯罪者に効果的な対抗手段を提供します。 DASF は、組織のセキュリティを確保するための実用的、運用的、効率的な方法です。" - クリス"ティト" セスティト、ヒドゥンレイヤーCEO兼共同創設者

DatabricksのAIセキュリティフレームワークをダウンロードし、当社チームにご相談ください。

Databricks AIセキュリティフレームワークのホワイトペーパーは、 Databricks Security and Trust Centerから ダウンロード できます。私たちは、正確性を確保するための努力を惜しみません。 ご意見、ご質問等ございましたら、[email protected]までご連絡ください。 このエイリアスでは、今後開催されるAIセキュリティ・ワークショップへの参加や、あなたの組織専用のワークショップの開催に関する詳細情報をリクエストすることもできます。 AIとMLのセキュリティに関する詳細なリソースについては、新しいAIセキュリティのページをご覧ください。